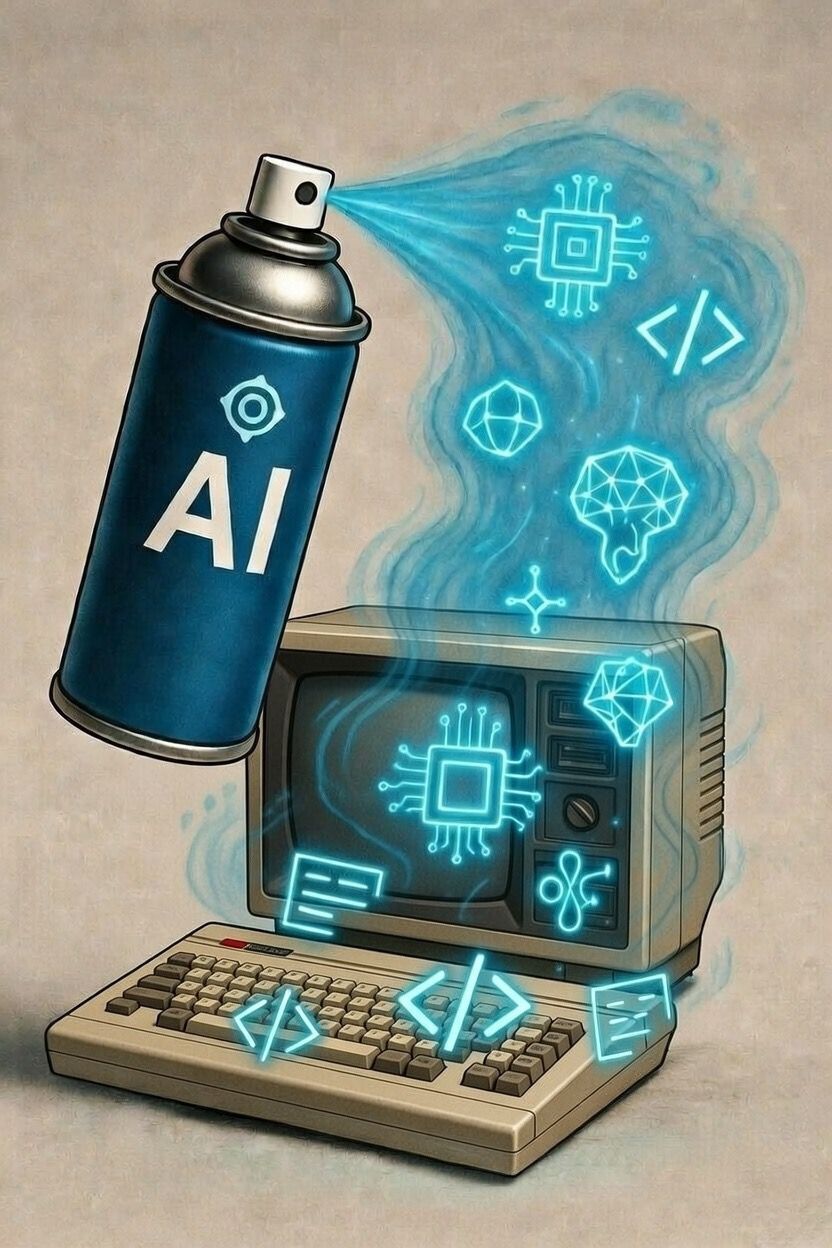

AI Spray: perché spruzzare AI su sistemi rotti non li rende migliori

L'AI è diventata la risposta universale ai problemi aziendali. Il servizio non converte? Aggiungiamo un chatbot AI. Il processo è inefficiente? Lo automatizziamo con un agente. I dati sono caotici? Un modello li ordinerà.

L'assunto implicito è sempre lo stesso: se aggiungiamo AI, il servizio migliora. È un'idea rassicurante, semplice, facile da vendere ai board e ai team, ma è anche profondamente sbagliata.

Un errore che è già stato commesso con il design

Questa logica non è nuova. Per anni, centinaia di organizzazioni hanno "spruzzato design" su prodotti e servizi strutturalmente scadenti, aspettandosi che un restyling visivo o qualche intervento superficiale risolvesse problemi di fondo. Non ha funzionato allora. Non funzionerà nemmeno con l'AI.

L'AI non è una bacchetta magica, è una tecnologia che amplifica ciò che trova. E se ciò che trova ha errori di base ed è confuso, amplificherà quello.

Dal Design Spray all'AI Spray

Il termine design spray è stato reso popolare da John Maeda, designer e tecnologo che ha osservato come le aziende abusano del design, applicandolo come un cosmetico, uno strato superficiale su software e servizi che sotto restano strutturalmente inadeguati. Si aggiunge un'interfaccia più moderna, si fa un restyling, ma i processi e la logica di fondo, restano invariati.

Oggi si sta replicando lo stesso errore con l'AI, solo che in questo caso l'impatto è più profondo, i costi più alti e le conseguenze più difficili da gestire.

Cosa significa AI spray

Chiamiamolo AI spray: usare l'AI come strato superficiale, senza riprogettare il servizio sottostante. È l'idea che basti inserire un large language model o un agente AI per trasformare un'esperienza mediocre in qualcosa di innovativo. Non funziona così.

Gli esempi sono ovunque. Chatbot inseriti sopra processi di supporto mal progettati che amplificano la confusione invece di risolverla. Agenti AI integrati in workflow mai formalizzati che agiscono su assunzioni errate e producono output imprevedibili. Automazioni costruite su dati incoerenti che scalano l'incoerenza a velocità industriale.

Il problema di fondo è sempre lo stesso: l'AI non risolve problemi di progettazione, li porta a galla, spesso in modi che non avevamo previsto.

Garbage In, Garbage Out (versione AI)

C'è un principio nel machine learning oggi è più attuale che mai: garbage in, garbage out. Se dai in pasto a un modello dati sporchi, incompleti, non contestualizzati, il modello non li corregge, li processa, ci costruisce sopra, restituisce output che sembrano plausibili ma sono fondamentalmente sbagliati.

Il mito del modello potente

L'errore comune è pensare che un LLM più potente compensi input di bassa qualità. Non è così. Anche il modello più avanzato applicato a dati scadenti alla fine produce risultati più confidenti, più articolati, ma altrettanto sbagliati. E questo è peggio, perché è più difficile accorgersi dell'errore.

L'AI non può spazzare via tutti i problemi, li scala. Prende ciò che è rotto (un processo, una fonte dati, una logica di business ambigua) e lo replica, lo accelera, lo distribuisce su larga scala. L'errore isolato diventa sistematico, la frizione gestibile diventa blocco operativo.

L'AI non corregge il garbage, lo rende solo più veloce, più complesso e più costoso.

Questa è la conseguenza diretta dell'AI spray. Invece di risolvere i problemi, li amplifichiamo. E quando questo accade nei sistemi agentici, dove l'AI non si limita a rispondere ma agisce, le conseguenze si amplificano ulteriormente.

Perché gli agenti AI falliscono davvero

Gli agenti AI falliscono spesso. Le implementazioni enterprise vengono abbandonate, i progetti pilota non scalano. Ogni volta che succede, sentiamo dire che “il modello non era abbastanza potente”, “la tecnologia non è ancora pronta".

La verità è che il problema non è il modello, è il servizio in cui quel modello è stato inserito.

I veri problemi sistemici che portano al fallimento

Gli agenti AI falliscono perché vengono integrati in servizi non progettati per accoglierli. Processi mai formalizzati, workflow dove le responsabilità sono ambigue, integrazioni improvvisate tra sistemi che non parlano la stessa lingua, assenza totale di metriche di adozione, di osservabilità, di criteri di successo chiari.

Un agente AI ha bisogno di struttura, cioè di sapere quando può agire, su quali dati, con quali vincoli, quando deve fermarsi. Se questa struttura non esiste, l'agente non può compensare, semplicemente riflette il caos e lo amplifica.

Il problema non è quale AI, ma in che servizio la inserisci. Finché non accettiamo questa premessa, vedremo progetti AI che promettono innovazione, ma portano solo frustrazione o altri problemi.

Perché l'AI spray è pericoloso

L'AI spray non è solo inefficace, è controproducente. E le sue conseguenze sono concrete, misurabili, e si manifestano rapidamente.

- Aumenta la complessità senza aumentare il valore.

Ogni livello di AI aggiunto a un sistema già fragile introduce nuovi punti di rottura, nuove dipendenze, nuovi fonti di errore. Il sistema diventa più difficile da mantenere, più costoso da evolvere, meno prevedibile. - Nasconde i problemi invece di risolverli.

L'AI può dare l'illusione di funzionamento, ma sotto la superficie i problemi strutturali restano intatti e quando emergono lo fanno in modo più grave. - Porta a perdita di fiducia nell'AI.

Quando un agente AI non funziona come promesso, l'utente non pensa "il servizio era mal progettato", pensa "l'AI non funziona". Questo danneggia la credibilità di tutte le iniziative AI successive.

L'AI spray non è un errore strategico minore. È una scelta che compromette la capacità di innovare, perché consuma risorse, brucia credibilità e costruisce su fondamenta già traballanti.

L'alternativa: progettare il servizio prima dell'AI

L'approccio corretto non parte dall'AI, parte dal servizio. Prima di scegliere quale modello usare, serve verificare che il servizio abbia fondamenta solide:

- processi chiari e formalizzati;

- flussi definiti e documentati;

- responsabilità assegnate e verificabili;

- dati affidabili, contestualizzati e di qualità.

Se queste basi non esistono, l'AI non risolverà nulla, anzi, peggiorerà la situazione amplificando ogni fragilità strutturale.

Il Service Design come fondamento

Gli agenti AI devono essere progettati come componenti del servizio, applicando i principi consolidati del Service Design: mappare i journey reali degli utenti per capire dove l'agente può effettivamente aggiungere valore, identificare i touchpoint critici e definire con precisione come l'agente si integra nei workflow esistenti.

Ma non basta. È necessario costruire metriche di osservabilità che rendano trasparente il comportamento dell'agente e permettano di capire cosa funziona e cosa va corretto. Bisogna implementare cicli di miglioramento continuo basati sui feedback dagli utenti, dai dati operativi e dalle interazioni quotidiane.

Il problema dell'AI spray è anche di complessità mal gestita. Si aggiunge tecnologia su tecnologia sperando che risolva problemi strutturali, moltiplicando i layer senza creare valore. John Maeda afferma che "the simplest way to achieve simplicity is through thoughtful reduction" e che "simplicity is about subtracting the obvious, and adding the meaningful." Questo vale anche per i sistemi AI. Serve ridurre consapevolmente la tentazione di "spruzzare" tecnologia su ogni problema, e concentrarsi su ciò che conta: processi ben strutturati, dati di qualità, integrazione pensata, osservabilità continua.

Questa non è burocrazia, è l'unico modo per far funzionare l'AI davvero.

L'AI non salva servizi mal progettati

L'AI non trasforma automaticamente un cattivo servizio in uno buono e innovativo. Al contrario, senza progettazione, l'AI non è innovazione, è solo garbage accelerato. Per questo, la domanda giusta non è "Come usiamo l'AI?", ma "Quale processo è abbastanza solido da essere potenziato dall'intelligenza artificiale?". Se la risposta è "nessuno", allora serve lavorare prima sulla struttura, poi sulla tecnologia.

L'AI produce risultati quando è integrata in un sistema pensato per accoglierla, non quando viene spruzzata su problemi esistenti. Allo stesso modo, gli agenti hanno successo quando fanno parte di un servizio ben strutturato, non quando sono un tentativo di mascherare fragilità sistemiche. In entrambi i casi, l'innovazione nasce dal progetto, non dall'applicazione superficiale di strumenti avanzati.

Finché tratteremo l'AI come una scorciatoia, costruiremo sistemi destinati al fallimento. E continueremo a chiederci perché l'intelligenza artificiale "non funziona", quando il vero problema è che forse non abbiamo progettato nulla che potesse funzionare davvero.

Ti consigliamo anche